La importancia de saber lo que no sabes

Si bien es cierto que los humanos podemos ser torpes, desinformados y dogmáticos, también somos capaces de detenernos, pensar y declarar honestamente: “No lo sé”. Esa frase, dicha con sinceridad, es uno de los signos más refinados de la inteligencia humana. Las máquinas, por potentes que sean, aún no han aprendido a callar cuando deben

Si le preguntan si sabe el número de teléfono del Papa, casi con total seguridad me responderá inmediatamente que no. No necesitará pensarlo un rato, ni hacer memoria. Sabemos que no lo sabemos, y punto.

Saber lo que no sabemos es muy importante, y no es simplemente una cuestión de realismo o de humildad. Es en realidad una de las piedras angulares de la inteligencia consciente. Una de las formas más profundas de sabiduría, que llevó a Sócrates a pensar que solo sabía que no sabía nada. En cierto sentido, podríamos decir que los humanos -no todos- somos los únicos animales conscientes de su ignorancia. Eso nos convierte en aprendices perpetuos.

La ignorancia reconocida es un tipo de conocimiento. Saber que uno no sabe permite preguntar, investigar, abstenerse de emitir juicios temerarios y, sobre todo, tomar decisiones con una dosis saludable de cautela. En cambio, ignorar la propia ignorancia es peligrosamente parecido a la estupidez, si no es lo mismo. La tragedia no está en no saber, sino en no saber que no se sabe o en no querer saber lo que se ignora.

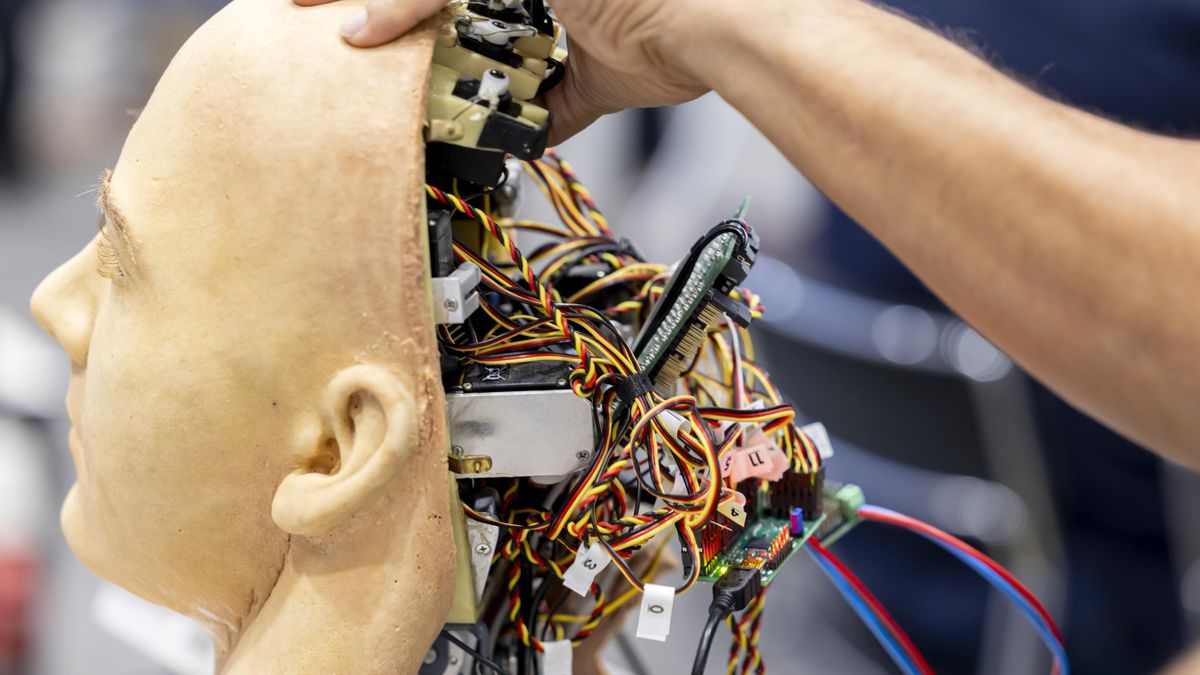

Ahora bien, en los últimos años ha emergido un nuevo actor en este teatro del conocimiento: la inteligencia artificial. Más concretamente, los grandes modelos de lenguaje (LLM, por sus siglas en inglés). Estos modelos de IA son capaces de responder preguntas, resumir textos, traducir lenguas y hasta de escribir ensayos como este -aunque no haya sido el caso-. Pero hay diferencias cruciales entre lo que hacen las máquinas y lo que hacemos nosotros. Por ejemplo, una IA no sabe que no sabe y esto es una limitación funcional.

Un modelo de lenguaje predictivo no tiene conciencia ni intención, y tampoco duda. Su misión es generar la siguiente palabra probable en una secuencia; y tras ella otra, y así sucesivamente, en un camino que podría no tener fin, siguiendo patrones estadísticos adquiridos a partir de millones de ejemplos de texto. Cuando responde, no tiene “conocimiento” en el sentido humano del término, sino un inmenso sistema de correlaciones aprendido. No accede a la verdad; accede a patrones. Al igual que Borges nos habló de un mapa que tenía el tamaño del imperio que cartografiaba, coincidiendo punto a punto con él, y que era tan inútil como preciso, la IA podría leerlo y escribirlo todo sin comprender nada.

Imaginemos que nos pregunten sobre un tema del que somos completamente ignorantes: en mi caso, por ejemplo, la estructura cristalina del telurio. Quizás tras pensarlo unos segundos, confesemos nuestra ignorancia y, en su caso, nos tomemos algo de tiempo para consultar una fuente fiable. Esta actitud, lejos de ser un signo de debilidad, es una sofisticada señal de inteligencia metacognitiva: el individuo no solo no sabe, sino que sabe que no sabe. En cambio, un LLM generará sin vacilar un párrafo elocuente sobre el telurio, y podría hacerlo mezclando verdades, imprecisiones y alguna elegante falsedad. No se trata de mala fe (las máquinas carecen de ella), sino de un automatismo que ignora el alcance de su saber.

Este fenómeno tiene un nombre: alucinación algorítmica. No se trata de errores simples, sino de respuestas que suenan plausibles, que están gramatical y estilísticamente bien construidas, pero que son falsas. El problema no es solo que la máquina se equivoque, sino que no sabe que se está equivocando. En su universo sintáctico no hay diferencia entre certeza, conjetura o pura invención.

En los humanos, por el contrario, la duda ha sido una palanca evolutiva. Nuestra conciencia de los límites del conocimiento ha permitido el surgimiento de la ciencia, del método experimental, de la verificación empírica y de la propia filosofía. Kant lo dijo de forma muy clara: “La razón humana tiene el destino singular de verse acosada por preguntas que no puede ignorar y que, sin embargo, no puede responder”. Esa incomodidad ante lo ignorado es lo que nos empuja a investigar permanentemente.

Pero ¿qué ocurre cuando los humanos empiezan a confiar demasiado en sistemas que no conocen su propia ignorancia? Corremos el riesgo de trasladar nuestro pensamiento crítico a una entidad acrítica. En otras palabras: dejamos de preguntarnos si algo es verdad simplemente porque lo ha dicho una máquina que responde sin saber si sabe. No deja de ser una paradoja que aquello que ignora su ignorancia sea, hoy por hoy, lo que más firmemente aparenta saber.

Por supuesto esto no significa que debamos rechazar la IA, pero sí comprender su arquitectura epistemológica. El conocimiento humano está vinculado a la experiencia, la duda, el contexto, la emoción, el juicio moral y la intersubjetividad. El conocimiento algorítmico, en cambio, no se pregunta nada, no se corrige a sí mismo (a menos que lo programemos específicamente para ello), y no tiene idea del riesgo que implica equivocarse.

Como decía Montaigne: “Que no sepa la causa de los terremotos no me avergüenza tanto como que me sea indiferente no saberla”. La IA no sufre ese pudor epistemológico. No le importa no saber, ni siquiera equivocarse, porque no sabe que se equivoca. Nosotros, en cambio, construimos ciencia, filosofía y prudencia sobre la base de nuestra inseguridad cognitiva.

De modo que, si bien es cierto que los humanos podemos ser torpes, desinformados y dogmáticos, también somos capaces de detenernos, pensar y declarar honestamente: “No lo sé”. Esa frase, dicha con sinceridad, es uno de los signos más refinados de la inteligencia humana. Las máquinas, por potentes que sean, aún no han aprendido a callar cuando deben. Tal vez, cuando lo hagan, estemos realmente ante un nuevo tipo de conciencia. ¿Estamos preparados para convivir con entidades que, como nosotros, puedan dudar? No lo sé.